KI-Boom erfordert neue Konzepte Mit Flüssigkeit kühlen, mit Servern heizen

Anbieter zum Thema

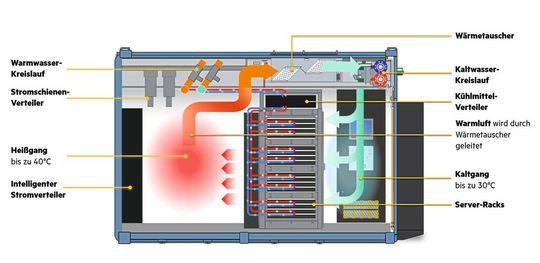

Der KI-Boom treibt den Stromverbrauch der Rechenzentren in die Höhe. Deshalb müssen jetzt Verfahren wie direkte Flüssigkeitskühlung und Abwärmenutzung zum Standard werden. Container-Rechenzentren können den Wandel beschleunigen.

Das Gehirn zeichnet für ein Fünftel des Energieverbrauchs des menschlichen Körpers verantwortlich [1]. Das klingt nach viel, doch unsere kleinen grauen Zellen arbeiten unglaublich energieeffizient: Unser Gehirn braucht nicht mehr Energie als eine Glühbirne – es ist eine „20-Watt-Serverfarm“ [2].

KI scheint mit dem menschlichen Gehirn in immer mehr Disziplinen gleichzuziehen – allerdings ist KI im Vergleich dazu ein echter Hitzkopf. Laut einer Studie benötigte OpenAI für das Training von GPT-3 (das Basismodell, das ChatGPT anfangs nutzte) 1.287 Megawattstunden [3]. So viel Strom verbrauchen rund 450 deutsche Vier-Personen-Haushalte im ganzen Jahr [4].

Melden Sie sich an oder registrieren Sie sich und lesen Sie weiter

Um diesen Artikel vollständig lesen zu können, müssen Sie registriert sein. Die kostenlose Registrierung bietet Ihnen Zugang zu exklusiven Fachinformationen.

Sie haben bereits ein Konto? Hier einloggen

:quality(80)/p7i.vogel.de/wcms/dc/f8/dcf855c07b0fdd1117eba0192b11a69c/0130163394v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/78/76/7876bfdb44623f549a6d03b084576adb/0130015902v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/42/ae42d571030951d07d6123ff2f60d20b/0130022507v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/01/fe0191223d6cfe28be5b3b3c85277db5/0129579847v4.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/60/f460f52ef03b4cecb5781cf25320e29e/0130821528v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/ac/9bacd1a94d5414ad45e88ff78b7c15c2/precision-power-laser-prozess---preview-1000x563v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/1f/4a1f0518e8a783fd7a6130e79dfb4531/0131290626v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/50/d3/50d3c34eace0bd829d9a90acef65b7ab/0131181642v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6c/8f/6c8f78a64854d77774a150d57b012d5b/0131285892v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/80/37801a6136caebc3089cd13270f71021/0131273429v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/37/3737f232445a933cb22b148e3f6eb2b5/0125458178v4.jpeg)

:quality(80)/p7i.vogel.de/wcms/4c/ac/4cacd088fcda611ce3e9129ffee7884c/0131157905v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/77/b1/77b158f69f48d3d484316e82b82a6fe7/0131208074v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/8b/638b143fd891eff1fe0857103ed11f05/0131165798v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8c/c2/8cc2745b888b63aa402e82b4dc7caab2/0131135778v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/71/bf71b934230dd347c79914151b9d5ef8/0131129086v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/e9/f4e9ccc92a6c2970ab969ce3fb6ab85d/lapp-us-stock-email-robots-servo-assemblies-2023-583x328v1.png)

:quality(80)/p7i.vogel.de/wcms/ba/a3/baa32b0c5f5d87955b154717a6895dad/0131045459v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/01/7b/017b0e42ac341e0cf84aace3fc205cfb/0131262313v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/56/ec/56ec7fbb0deae1a9c0154b500cde3bce/0131003779v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/fb/77/fb770d7bb8158f5336820460ee063200/0130800023v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/8d/418d1e5a0047cb9a168dec1df2195469/0131221372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f2/be/f2bef31b33113753b3d407f260d4bcc1/0131191340v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5f/0f/5f0f3b3de15d0a21d8e3320a4e833d62/smart-20factory-20day-202-13-6088x3423v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/11/6611bfcac2e56f5238278843142faa13/0131264749v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/aa/01/aa01309a17e75e6c9f32e851b0b0440b/0131252026v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/34/b434445f3e72c993a048148c230aff80/0131271775v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/7c/817ccdcda33e1973c37a5724169cfd06/0131243316v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/45/2f/452f80a85ae228921f087b04e55c0f82/0131201590v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/54/11/541125b2d206c7532437b6bf0a98b6de/0101144676v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/5c/485cf545f728e4b0164b832dae7f63ec/0109052935.jpeg)

:quality(80)/p7i.vogel.de/wcms/96/9e/969e5b78fe8a0ba6088913a107471566/0109295155.jpeg)

:quality(80)/p7i.vogel.de/wcms/ca/20/ca20f03bcb7e0b46d69495ad92782048/0105054936.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/94/f194f244a3929760943e30acf0c59507/0131272053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/0b/cc0bbcb973719954c5272ec4d6fa0ce4/0127386265v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/74/c4741bb9b5a99f4172594e5891972055/0127325727v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/93/0d9352da2f882b748309aab18f143489/0127031928v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9d/c6/9dc65fd44e7e479e370409a026ff8aa4/reinraum-fuer-pharma-und-medizintechnik-anforderungen-erfuellen-800x450v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fb/69/fb690a68ac9e813f7d1300075a75007e/high-tech-produkte-fertigen-modulare-betriebsmittel-als-vorteil-800x450v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/c2/2ec20521d62b2ad02724fedce6fef527/aluprofil-konstruktion-software-fuer-maximale-zeitersparnis-800x450v1.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/65100/65191/65.jpg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/45900/45920/65.jpg)

:fill(fff,0)/p7i.vogel.de/companies/66/79/66797a748658c/all-for-one-group-rgb-600.png)

:quality(80)/p7i.vogel.de/wcms/b7/b5/b7b573334255580d000b3b331afa0b17/0127999616v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a0/a5/a0a5ecbb1b5d99ab0318691403809f9b/0130637855v2.jpeg)